In breve

Anthropic ha reso pubblici i prompt di sistema per i suoi tre modelli linguistici Claude, segnando un importante passo avanti nella trasparenza del settore dell'intelligenza artificiale generativa.

Cosa sono i prompt di sistema?

Nel mondo dell'intelligenza artificiale (IA), i “prompt di sistema” fungono da istruzioni operative per i large language model (LLM): essi definiscono le regole generali, i comportamenti e le "personalità" che i modelli dovrebbero esibire durante le interazioni con gli utenti. Questi prompt vengono a tutti gli effetti inseriti in tutte le conversazioni con il chatbot, in modo da influenzarne il comportamento, ma senza essere mostrati all’utente.

Fino ad ora, la maggior parte delle aziende di IA, come OpenAI e Google, ha mantenuto questi prompt segreti. Anthropic, la compagnia madre del modello Claude, ha deciso di cambiare le carte in tavola.

I prompt di sistema di Claude

Anthropic ha recentemente pubblicato i prompt di sistema per i suoi tre principali modelli: Claude 3.5 Sonnet, Claude 3 Haiku e Claude 3 Opus. I prompt sono disponibili a questa pagina.

Inoltre, Anthropic si è impegnata a mantenere il pubblico aggiornato sui cambiamenti futuri dei prompt di sistema, stabilendo un nuovo standard di trasparenza nel settore.

Che cosa rivelano i prompt di sistema?

La pubblicazione dei prompt di sistema offre uno sguardo inedito sulle capacità e le caratteristiche di ciascun modello di Claude.

Tutti i prompt di sistema includono la data di aggiornamento della conoscenza del modello (aprile 2024 per Sonnet, agosto 2023 per Opus e Haiku). Essi istruiscono inoltre i modelli a rispondere in modo conciso a domande brevi ma ad elaborare di più per domande più complesse, e ad aiutare l’utente con compiti diversi. Inoltre:

- Claude 3.5 Sonnet, il modello più avanzato, è istruito a gestire argomenti controversi con cautela, a evitare frasi fatte come “certamente!”, ad avvertire l’utente in caso di probabili allucinazioni, e a ragionare passo per passo in caso di domande di logica. È inoltre presente una sezione in cui si dice al modello, in caso di immagini allegate con volti di persone, di rispondere come se non riconoscesse le persone nell’immagine, a meno che l’utente non gli dica espressamente di chi si tratta.

- Claude 3 Opus, il modello leggermente meno avanzato di Sonnet, è istruito a offrire prospettive bilanciate su temi controversi e ad avvertire l’utente di probabili allucinazioni, anche se in maniera meno estesa rispetto a Sonnet.

- Claude 3 Haiku, il modello meno avanzato ma più veloce, non ha istruzioni aggiuntive oltre a quelle comuni a tutti i modelli.

Le implicazioni di questa decisione

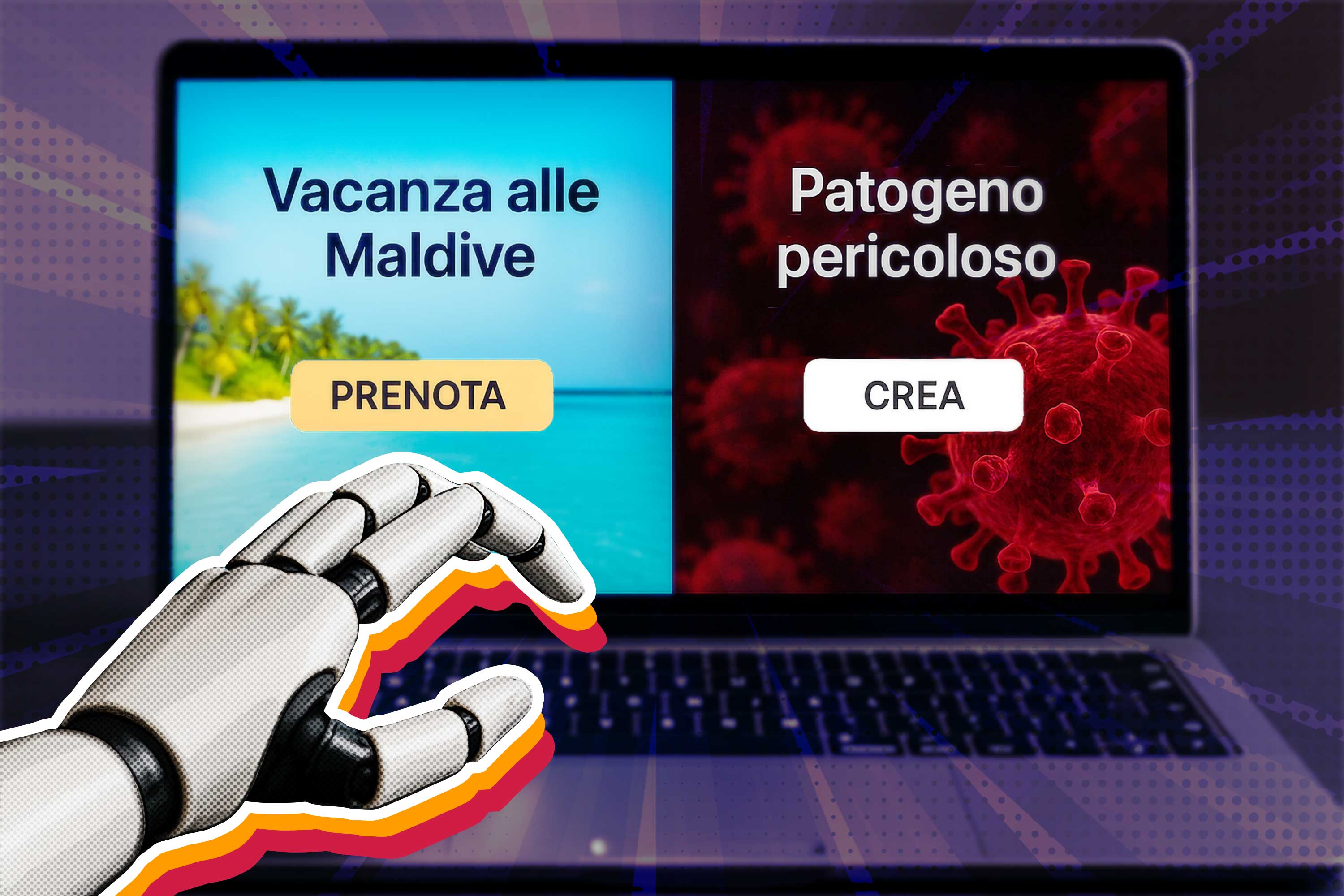

La decisione di Anthropic di rendere pubblici i prompt di sistema rappresenta un passo avanti verso una maggiore trasparenza nel campo dell'IA generativa. Questo gesto apre parzialmente la "scatola nera" dell'IA, permettendo agli utenti e agli sviluppatori di comprendere meglio come questi modelli sono progettati per funzionare e comportarsi.

Sebbene i modelli non siano completamente open source - il codice sorgente, i dati di addestramento e i parametri numerici del modello rimangono proprietari - questa mossa offre comunque preziose informazioni sul funzionamento interno di questi avanzati chatbot.

La pubblicazione dei prompt di sistema potrebbe incoraggiare altre aziende di IA a seguire l'esempio, portando potenzialmente a una nuova era di trasparenza e responsabilità nel settore. Per gli utenti, questa trasparenza si traduce in una migliore comprensione delle capacità e dei limiti dei modelli di IA con cui interagiscono quotidianamente.