In breve

OpenAI ha lanciato o1, un nuovo modello di intelligenza artificiale con capacità di "ragionamento" più avanzate rispetto agli altri modelli esistenti. Tuttavia, l'azienda ha deciso di non rivelare i passaggi del processo di ragionamento del modello.

I modelli o1: di cosa si tratta?

OpenAI ha recentemente presentato due nuovi modelli di intelligenza artificiale (IA): o1 e o1-mini. Questi modelli promettono capacità di ragionamento superiori, particolarmente efficaci in ambiti come la programmazione, la matematica e le scienze.

In particolare, le prestazioni di o1 sono notevoli in compiti complessi e che richiedono un numero elevato di passaggi. o1 supera GPT-4o in test di matematica avanzata, scienze e programmazione; GPT-4o mantiene comunque un vantaggio in compiti che richiedono conoscenze generali e capacità di navigare su internet o elaborare immagini.

o1 presenta costi significativamente più elevati rispetto all’altro modello di punta di OpenAI, GPT-4o. Per esempio, i costi per accedere all’API di o1 si aggirano tra il triplo e il quadruplo rispetto all’API di GPT-4o.

Nuova tecnologia, nuove sfide

I modelli o1 sono stati sviluppati utilizzando un algoritmo di ottimizzazione completamente nuovo e un set di dati di addestramento specifico. Questo approccio innovativo mira a ridurre le "allucinazioni" dell'AI, anche se il problema non è stato completamente risolto. È importante sottolineare che la tecnologia alla base di o1 è ancora in una fase iniziale di sviluppo, e OpenAI descrive questi modelli come un "anteprime" per enfatizzare la loro natura nascente.

Il cuore di o1: chain-of-thought

Al centro delle capacità di o1 c'è la tecnica del "chain-of-thought", traducibile in italiano come “catena di pensieri”. Questo metodo permette all'IA di elaborare problemi complessi passo dopo passo, simulando un processo di ragionamento umano. Il chain-of-thought migliora generalmente l'accuratezza delle risposte e riduce gli errori, ma ha anche dei limiti: non garantisce sempre risposte migliori e può aumentare i tempi di elaborazione e i costi computazionali.

Ragionamenti nascosti: la decisione controversa di OpenAI

OpenAI ha deciso di non rivelare il chain-of-thought “grezzo” di o1 agli utenti. Questo significa che, mentre l'IA utilizza internamente un processo di ragionamento passo-passo per giungere alle sue conclusioni, gli utenti non potranno vedere questi passaggi intermedi del processo di pensiero del modello. Se un utente cerca di aggirare questa limitazione chiedendo espressamente al modello di “ragionare passo per passo”, quello che vedrà sarà una versione diversa dai passaggi interni seguiti dal modello.

OpenAI ha citato diverse ragioni per questa scelta.

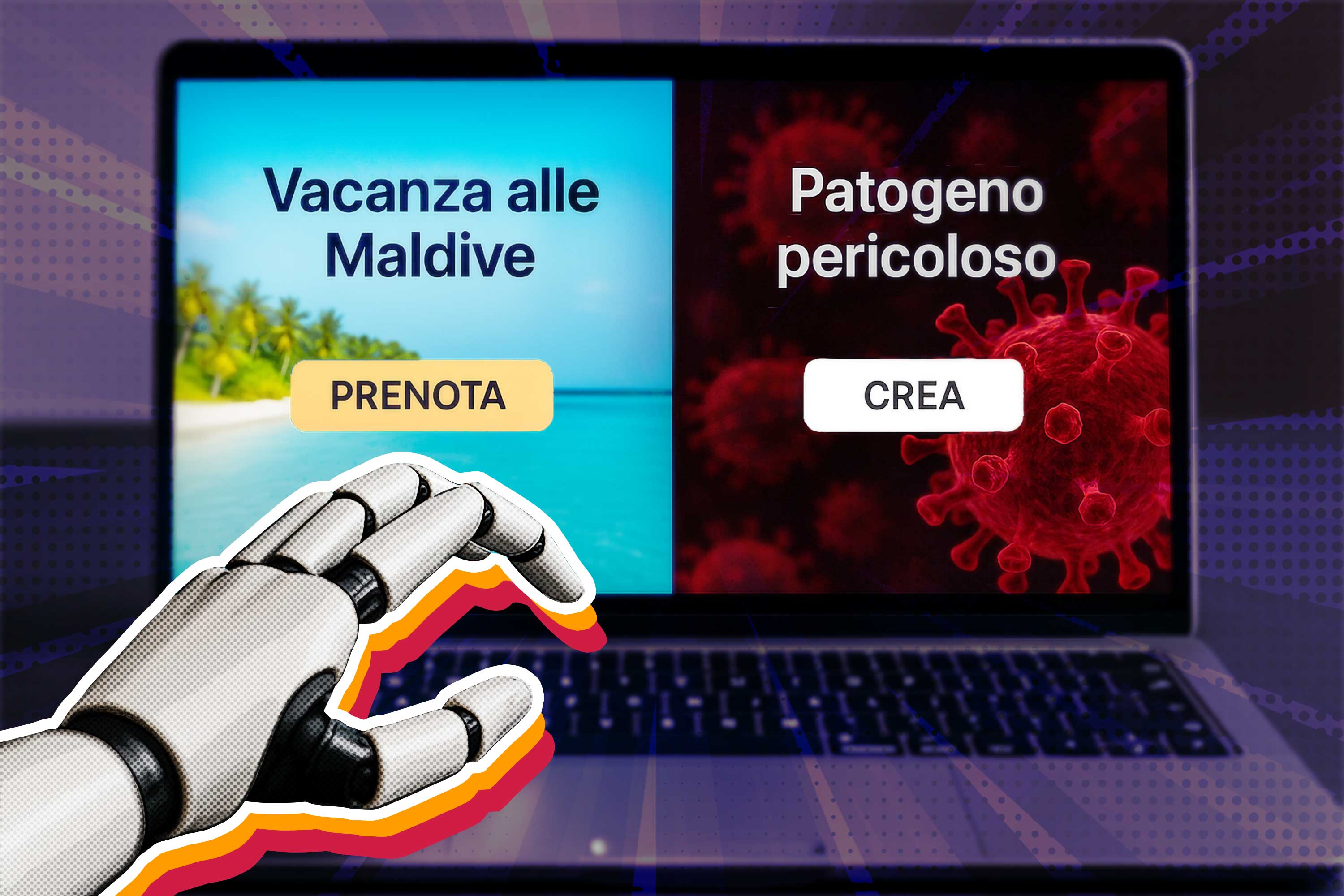

- Sicurezza: l'azienda teme che il processo di pensiero grezzo potrebbe fornire informazioni sensibili che potrebbero essere sfruttate da malintenzionati per manipolare o compromettere il sistema.

- Protezione della proprietà intellettuale: rivelare i dettagli del processo di ragionamento potrebbe permettere ai concorrenti di replicare o migliorare la tecnologia di OpenAI.

- Monitoraggio interno: OpenAI suggerisce che mantenere nascosta la catena di pensiero permette loro di monitorare internamente il comportamento del modello, ad esempio per identificare eventuali tentativi da parte del modello di manipolare l'utente.

- Esperienza utente: l'azienda ritiene che mostrare il processo di pensiero grezzo potrebbe essere fuorviante o confondere gli utenti medi.

- Flessibilità del modello: nascondere il processo interno permette al modello di esprimere i suoi "pensieri" in forma non alterata, senza dover applicare filtri etici alla catena di pensiero stessa.

Questa decisione potrebbe avere ripercussioni significative nel panorama dell'IA generativa. Da un lato, potrebbe spingere altri sviluppatori a offrire maggiore trasparenza come vantaggio competitivo, permettendo agli utenti di vedere il processo di ragionamento dei loro modelli. Dall'altro, potrebbe stabilire un precedente di mancanza di trasparenza nei sistemi di IA avanzati. Per la comunità scientifica e gli esperti di etica dell'IA, la mancanza di trasparenza potrebbe ostacolare la ricerca e la comprensione di come questi sistemi avanzati giungono alle loro conclusioni.

Verso un'IA più autonoma, ma non ancora umana

Con le capacità di “ragionamento” più avanzate di o1, OpenAI ha sicuramente voluto fare un passo avanti verso sistemi IA più autonomi e con maggiori capacità di prendere decisioni. Ad ogni modo, è fondamentale ricordare che non si tratta ancora di un vero "pensiero" nel senso umano del termine. o1 rimane essenzialmente un sistema basato su schemi statistici del linguaggio umano, anche se più sofisticato dei suoi predecessori. Le sue capacità sono il risultato di calcoli complessi e non di una vera comprensione o coscienza.